AIは嘘をつくから使えない。なんて皆さんは同僚などからこんな話を聞いたことがありませんか?

私は、AI推しの人間なのでこの言葉が非常に残念でした。

そこで今回は、AIの仕組みを理解することで、なぜAIが嘘をつくのか?また嘘をつかないためのコツ3選をご紹介していきます。

この記事でわかること

- AIの仕組み

- なぜハルシネーションがおこるのか?

- Copilotを賢く使いこなすための3つのコツ

目次 閉じる

AIは嘘をつく

初めてAIを使ったとき、私は、「AIはまるで魔法のようだ」と感じました。

それは

- 自分の伝えたいことを簡潔にまとめてくれるから

- 計算や提案をしてくれるから

- Python等のコード生成をしてくれるから

私の苦手なところを補填してくれる相棒でしたが、逆に使っていく中で苦手なところもあることがわかりました。

それは、「嘘」をつくこともあるのです。

AIはどのように答えを出しているのか?

それはAIの構造を知ると、理解できます。

ここで簡単な質問をします。

「あけまして」の次につながることばを教えてください。。

あなたならなんと答えますか?

…答えは「おめでとうございます」です。

なぜ、私たちはこの答えを思いつくのでしょうか?

それは、私たちの頭の中に、社会生活の中で積み重ねてきた「常識」や「言葉の強い結びつき」があるからです。私たちはこれまで、様々な場所で「あけまして、おめでとうございます」という言葉を何度も聞いたり話したりしてきました。

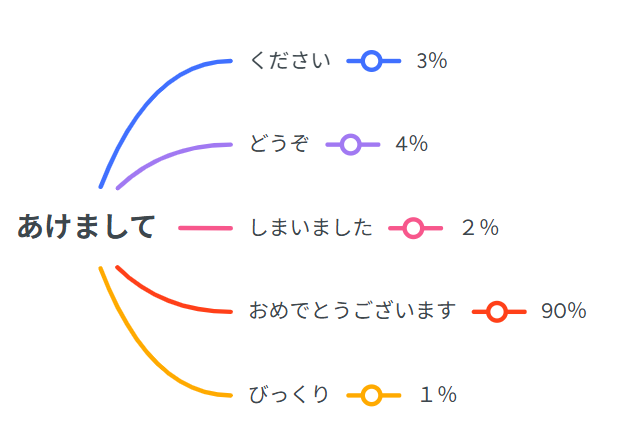

実はAIも同じです。 下の図でAIの処理の方法を簡単にイメージにまとめてみました。

このイメージ図では、AIが「あけまして」の後に続く言葉を検索し、その検索した言葉について、確率を導き出していることを示しています。

このあけましての後に続く言葉に対し90%の確率だから、「おめでとうございます」が適切あると判断し答えを生成するようになっています。

上記のイメージ図で説明した通り、AIは「新年を祝う」という感情を理解しているわけではありません。ただ単に、次に続く言葉として最も確率が高いと「予測」しているだけなのです。

このシンプルなクイズが示すように、Copilotは言葉の意味を理解するのではなく、言葉のパターンを選び出し確率が高い言葉を出力しているのです。

AIはなぜ嘘をつくのか?

前回の問題を踏まえた上でもう1問クイズを出します。

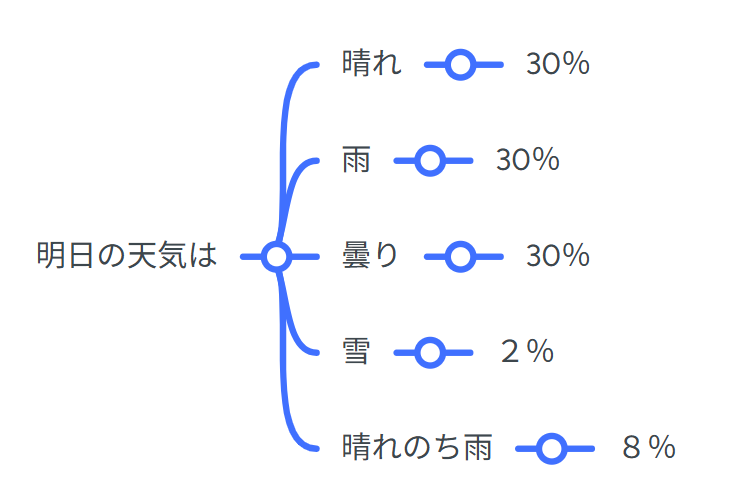

明日の天気は?

皆さんだったらこの「明日の天気は?」に対する回答はなんと回答しますか?

とても悩むと思います。確率の30%を同じであればなおのことです。

そうです。この天気予報が外れることを「ハルシネーション」(幻覚)と呼びます。

ハルシネーションの正体

AIは言葉の意味を理解していないため、「知らない」という概念がありません。学習データに答えがなくても、最もらしい言葉を「予測」し、勝手に作り上げてしまいます。

- 信頼性の低い検索ソース インターネット上の誤った情報や古い情報を学習してしまう。

- 専門性が非常に高くインターネットに情報に乗っていない。

- 最新の情報であり、学習されていない。

これらが組み合わさることで、AIは存在しない会社名や引用元、誤った統計データなどを、あたかも事実であるかのように提示してしまうのです。ハルシネーションは、AIのバグではなく、現在のAIの特性であると理解することが重要です。

なぜ「Copilot(副操縦士)」なのか? AIと人間の役割分担

ここまで、AIの「予測」という仕組みと、情報源の特性について説明しました。これらの特性を踏まえると、なぜMicrosoftがこのAIを「パイロット(操縦士)」ではなく、「Copilot(副操縦士)」と名付けたのかが明確になります。

AIは、あくまであなたの副操縦士です。

飛行機の副操縦士は、パイロットの指示に従い、計器の確認や通信など、多くのタスクを正確に処理します。しかし、最終的な飛行判断や緊急時の対応、そして安全な着陸の責任はパイロットにあります。

AIも同様です。

AIの役割(副操縦士): 情報収集、データ分析、文章の下書き、ブレインストーミングなど、あなたをサポートする膨大な作業を代行します。

AIが出力した結果を人間(Pilot)が確認し、正しい情報かどうかを判断する。

AIの出力された結果は必ず正しいのか?その判断をするのは人間の役割です。

Copilotを賢く使いこなすための3つのコツ

ハルシネーションは避けられない特性ですが、それを理解し、適切に対処することで、Copilotはあなたの強力な味方になります。以下に、すぐに実践できる3つのコツを紹介します。

1. プロンプト(指示文)を具体的に書く AIへの指示が曖昧だと、AIは意図を汲み取れず、誤った情報を生成するリスクが高まります。

NG例

- 「日本の自動車産業について教えて」

OK例

- 「2024年の日本の主要な自動車メーカー3社の販売台数を比較し、今後のトレンドについて考察してください。

具体的な指示を与えることで、AIの出力精度が格段に向上します。

2. 出力されたデータの信頼性を確認するために参照元のデータを開示してもらいましょう。

プロンプトに

出力されたファクトチェックのために、参照元のリンクを添付してください。

3. 情報ソース元がわかっているのであれば、ソース元から検索してなどの様に事柄を絞るようにしましょう。

プロンプトに

http;//●●●から情報を検索してしてください。指定されたサイトに答えがない場合は「ない」と回答してください

具体的なプロンプトの指示については、Copilotの回答が変わる!より回答精度を上げる方法でMicrosoftの公式情報を基に説明していますのでぜひご覧ください。

まとめ:賢いパイロットは、優秀な副操縦士を使いこなす

Copilotは、あなたの仕事を効率化し、生産性を飛躍的に高める可能性を秘めたツールです。しかし、その力を最大限に引き出すには、あなたが「賢いパイロット」になる必要があります。

AIの仕組みを理解し、その特性を認識し、ハルシネーションに動じることなく、AIを「アシスタント」として使いこなす。それが、次世代のビジネスパーソンに求められるスキルなのです。